AIの進化は私たちの生活を便利にする一方、予期せぬ不具合や不安を感じさせることもあります。その中でEUでは、2024年8月にAI規制法(AI Act)が発効し、2025年2月からは禁止AIの規定や基本的な条文の適用が順次始まりました。 さらに2026年8月2日には、多くの高リスクAI関連の義務を含む主要な規定が本格的に適用される予定であり、段階的な施行を通じて禁止AIや生成AIへの規制が現実のものとなりつつあります。EUでAI規制法の発効された背景やメリット・デメリット、日本の現状などもわかりやすく解説します。

目次

AI規制法とは

AI技術の急速な進化と社会への影響拡大を受け、世界で初めて包括的なAI規制法がEUで成立しました。AIがもたらす利便性や経済効果を享受しつつも、

- 人権

- 安全保障

- 倫理的リスク

などへの懸念が高まる中、「どこまでAIを許容し、どのように規制するべきか」という問いに対するEUの答えが、このAI規制法(EU AI Act)です。今後、世界のAI規制のスタンダードとなる可能性が高く、日本を含む各国の法整備やビジネス戦略に大きな影響を与えると見込まれています。

まずは、AI規制法の全体像とその特徴を理解を確認していきましょう。

EUのAI規制法の概要と4つのリスクレベル

EUのAI規制法は、AIシステムのリスクを4段階に分類し、それぞれに応じた規制を設ける「リスクベースアプローチ」を採用しています。この枠組みは、AIのもたらすリスクと社会的便益のバランスを取りつつ、技術革新を阻害しないことを目指しています。

①許容できないリスク(Unacceptable Risk)

人権侵害や社会的に深刻な悪影響を及ぼすAIシステムは、原則としてEU域内での開発・提供・使用が全面禁止されます。具体例としては、

- サブリミナル技術(無意識下で人の行動を操作する技術)

- 社会的スコアリング(個人を監視・評価する仕組み)

- 職場や教育現場での感情推測システム、

- 公共空間でのリアルタイム遠隔生体認証

などが挙げられます。

②ハイリスク(High Risk)

社会や個人に重大な影響を及ぼす可能性があるAIシステムが該当します。例としては、

- 重要インフラ(交通、医療、電力など)

- 雇用や教育

- 法執行

- 移民管理

などに使われるAIです。これらには、市場投入前に厳格な適合性評価や透明性の確保、監査記録の保存など、多岐にわたる義務が課されます。

③限定的リスク(Limited Risk)

主にAIによる透明性に関するリスクが対象です。例えば、AIが生成したコンテンツ(画像や文章など)を人間が容易に識別できるよう、AI利用の事実を明示する義務があります。

これにより、利用者がAIとのやりとりであることを認識し、誤解や不安を回避できます。

【限定的リスクAIの透明性の義務(52条)の例】

④最小リスク(Minimal Risk)

リスクが極めて低いAIシステムについては、特段の規制は設けられていません。多くのAIアプリケーションや日常的なサービスがこのカテゴリーに該当し、イノベーションやビジネスの自由な展開が担保されています。

【4つのリスクレベル】

この4分類により、AIの種類や用途ごとに最適な規制が適用される仕組みとなっています。特に生成AIや汎用AI(Generative AI、 General Purpose AI)についても、最新の社会動向を踏まえた規制が追加されている点は、世界的にも先進的です。

AI規制法の適用範囲

【「規則」(Regulation)→ 統一ルールの直接適用】

EUのAI規制法は、EU域内でAI製品やサービスを提供するすべての企業・組織を対象としています。EU域外の企業であっても、EU市場にAIシステムを展開する場合は同法の規制対象となるため、グローバル企業にとっても大きな影響があります。

AI規制法が適用される対象

EUのAI規制法が対象とするAIシステムは、

- 条件①:付属書Iに列挙された技術・手法で開発されている

- 条件②:環境に影響を与える出力を生成できる

とされています。つまりこの二つの条件、「作り方」と「機能・目的」が揃って初めて対象となる、と解釈できます。

【適用対象となるAIシステム】

条件①:付属書Iに列挙された技術・手法で開発されている(技術的基準)

AIシステムが、以下のいずれかの技術的アプローチを用いて開発されているAIが条件①に当てはまります。

- 機械学習

- 論理・知識ベースのアプローチ

- 統計的アプローチ

条件①では、技術の進展に応じて、欧州委員会が対象を定める「付属書I」を更新可能(委任規則により柔軟に対応)とされています。これにより、今後新しいAIが開発されても、必要であれば対象範囲に取り込むことができます。

条件②:環境に影響を与える出力を生成できる(機能的な基準)

AIシステムが、以下のような出力を生成し、物理的または仮想的な環境に影響を与える能力を持つAIが条件②に当てはまります。

- 予測(例:需要予測、故障予知)

- 推奨(例:ECサイトのレコメンド)

- 決定(例:融資審査の自動判断)

- コンテンツ生成(例:テキスト・画像生成)

条件②が対象とする「影響」の範囲は広く、ビジネス判断から個人の行動変更までを含みます。

注目すべきは、AI規制法が単なる技術規制にとどまらず、

- 基本的人権の保護

- 民主主義の維持

- 環境の持続可能性

など、社会全体の価値観を反映した包括的な法律である点です。法案策定には欧州委員会や欧州議会、欧州理事会などが中心的役割を果たし、各国の専門家や研究者も議論に参加しています。

EUのAI規制法は、リスクベースでAIを4つに分類し、用途やリスクに応じた規制を設けることで、イノベーションと社会的信頼の両立を目指しています。今後、世界のAI規制の基準となることが期待されており、日本を含む各国の法整備やビジネス戦略にも大きな影響を与えると予想されています。*1)

AI規制法が発効した背景

AI技術の急速な進化は、社会や経済に多大な恩恵をもたらす一方で、倫理・プライバシー・安全保障など新たなリスクも顕在化させました。こうした状況下で、AI規制法の必要性が世界的に高まっています。

なぜ今AI規制法が求められるのか、その背景や各国の動向、そして日本の基本理念について整理します。

AI規制法が必要とされた理由

AIの活用拡大により、

- 差別やバイアス

- プライバシー侵害

- 説明責任の欠如

といった問題が現実化しています。例えばAIチャットボットによる、

- 不適切な発言

- 個人情報の漏洩

- AIによる自動意思決定

などが社会的弱者に不利益をもたらす事例も報告されました。こうしたリスクへの対処が急務となり、現在ではAIの透明性や追跡可能性、説明可能性を担保する規制の必要性が強く認識されています

さらに、AIの判断根拠が不明瞭な「ブラックボックス問題」※や、AIが社会インフラに組み込まれることで生じる大規模な社会的影響※も懸念されています。これらの課題に対し、国際機関や各国政府が原則やガイドラインを策定し、法的拘束力を持つ規制の導入が進められています。

- システム障害による交通や電力の大規模停止

- サイバー攻撃による社会混乱

- AIの誤作動による事故や責任の所在不明

- 雇用の急減や格差拡大

などが挙げられる。

世界が目指すAI社会のビジョン

AI規制法は、イノベーションと社会的信頼の両立を目指し、技術の進化と倫理的価値観の調和を図るものです。AI規制法の根底には、「人間中心のAI社会」を目指す理念があります。

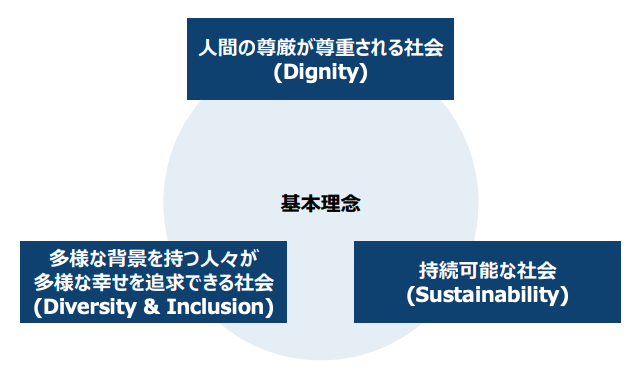

経済産業省・総務省が2025年3月に公表した「AI事業者ガイドライン(第1.1版)」では、

- 人間の尊厳や権利の尊重

- 多様な幸せの実現

- 持続可能な社会の構築

などを基本的な考え方として掲げています。

ガイドラインは、開発・提供・利用といったライフサイクル全体を通じて、リスクの把握や透明性・説明責任の確保を求めることで、イノベーション促進と人間中心のAI社会の両立を図ることを目的としています。

この理念は、OECDや内閣府が掲げる「人間中心のAI社会原則」とも共通し、AIを公共財として活用し、SDGsの達成や地球規模の課題解決にも貢献することが期待されています。

【AI事業者ガイドライン(経済産業省)基本理念】

世界各国の反応と規制アプローチ

EUは世界初の包括的AI規制法の制定に対し、

- アメリカ:州ごと・分野ごとの分散型アプローチを採用

- 中国:中央集権的な厳格管理

- 日本は、技術革新と社会的信頼のバランスを重視し、現時点では法的拘束力のないガイドライン中心

といった方針で、EU域外でもAIの規則整備を進めています。各国の規制戦略は、政治体制や社会的価値観、経済戦略によって大きく異なりますが、共通して「AIのリスクを抑えつつ、社会的利益を最大化する」ことを目指しています。

AI規制は今なお進化中であり、グローバルな議論と調整が続いています。今後も各国の規制動向や社会的議論に注目が集まるでしょう。*2)

AI規制法のメリット

AI技術の健全な発展と普及は、明確なルールがあってこそ、より確実なものになります。この法律は、AIが単なる強力なツールではなく、私たちの生活を真の意味で豊かにするための基盤を築く役割を担っています。

AI規制法が具体的にどのようなメリットをもたらすのか確認していきましょう。

利用者と市民の安全・安心の向上

最も直接的なメリットは、AIシステムを利用する人々や市民の安全と安心が高まることです。特に

- 医療

- 交通

- 雇用

など、人々の生活に重大な影響を与える可能性のある「高リスクAI」に対して厳格な安全要件や監視体制を義務付けることで、事故や予期せぬ損害のリスクを低減します。

また、プライバシー侵害や差別につながるようなAIの利用を禁止または制限することで、市民の基本的権利が保護されます。

市場の信頼性と公平性の確立

AIに関する明確なルールが整備され、公開されることで、AIを開発・提供する企業も、導入する企業も「どのような基準を守ればよいか」を理解しやすくなります。その結果、不正行為をする企業が減り、安全で信頼できるAIが市場に多く出回るようになります。

消費者も「このAIは安全かどうか」を判断しやすくなるため、安心してAIサービスを利用できる社会に近づいていきます。

EU域内のイノベーション促進

規制はイノベーションを阻害するように思われがちです。しかし、適切な規制はむしろ責任あるイノベーションを促進する側面も持ちます。明確なリスク分類と要件が示されることで、事業者はどのようなAI開発に注力すべきか、安全基準を満たすためには何が必要かを把握しやすくなります。

また、規制への適合を支援するサンドボックス※などの制度も整備されることで、事業者はリスクを管理しながら新しいAI技術の実用化に挑戦しやすくなります。信頼性が保証されたAIは、社会への導入もスムーズに進みやすいため、結果的にイノベーションの加速に繋がると考えることができます。

グローバルスタンダードとしての影響力

EUがいち早く包括的なAI規制を確立したことは、事実上の国際標準となる可能性を秘めています。EU市場は大きいため、EUの規制に対応することは、世界中のAI関連企業にとって避けられない課題となります。

EUのAI規制法の考え方や安全基準が、EU域外の国の規制や企業の開発基準にも影響を与え、世界全体のAIガバナンスの方向性を定める上で主導的な役割を果たすことが期待されます。

AI規制法は、AIの予測されるリスクを抑え、市民を守ることで、AIが社会に受け入れられ、責任ある形で普及・発展していくための強固な基盤を提供します。長期的に見たAI技術の最大限の利益が人類にもたらされることを目指しています。*3)

AI規制法のデメリット・課題

AI規制法は社会的信頼や安全性の向上を目指す一方で、実務・経済・法制度の各側面において多くのデメリットや課題も指摘されています。現場や企業、研究者からは、規制の厳格化が新たなイノベーションや事業展開の妨げになる懸念が根強く、今後の運用や国際競争力への影響に注目が集まっています。

イノベーション抑制と競争力低下の懸念

AI規制法の厳格な要件は、特に中小企業やスタートアップにとって大きな負担となり得ます。初期コストやコンプライアンス対応のための人材・資金が必要となり、開発スピードの低下や市場投入の遅延が生じることが指摘されています。

また、規制が緩い他国の企業が先行し、欧州企業が国際競争で不利になるリスクも懸念されています。

実効性・運用面での課題

2026年時点で、EU各国はAI規制法の本格適用に向けて監督当局の指定や体制整備を進めていますが、専門人材の不足や監督コストの増大は依然として大きな課題とされています。

また、禁止AIや高リスクAIの範囲、既存システムへの経過措置などについては、欧州委員会や各国当局がガイダンスやQ&Aを公表しているものの、事業者側からは「自社のAIがどのカテゴリーに該当するかが分かりづらい」といった声も上がっています。

こうした運用上の不確実性は、特に中小企業やスタートアップにとってコンプライアンス対応の負担や投資判断の難しさにつながるリスクがあります。

また、既存の法制度や他のデジタル関連法との整合性も課題です。

著作権・倫理・社会的影響への対応不足

生成AIによる著作権侵害や、AIが生み出す新たな倫理的・社会的リスクへの対応が十分でないという指摘もあります。特に、

- 著作物の無断利用

- 個人情報の扱い

- AIによる差別や偏見の助長

など、現行規制でカバーしきれない領域が今後の大きな課題です。

AI規制法は社会的信頼や安全性の確保に寄与する一方、イノベーション抑制や運用・実効性の課題、著作権や倫理面での不十分さなど、多面的な課題を抱えています。今後は、柔軟かつ実効的な運用と、国際的な調和が求められます。*4)

日本におけるAI規制法の現状

EUが包括的なAI規制法という形で明確なルールを確立する一方で、日本は異なるアプローチをとっています。現在の日本におけるAI規制や関連する取り組みはどのような状況にあるのでしょうか。

法規制よりもガイドライン中心のアプローチ

日本政府は、AI技術の進化速度が速いことや、厳格な法規制がイノベーションの芽を摘む可能性を考慮し、EUのような包括的な単一法を制定するよりも、まずは事業者向けのガイドライン策定や国際的な議論への参画を主軸としています。これは、変化に柔軟に対応できるソフトロー(法的拘束力のない規範)を中心としたアプローチと言えます。

リスクに対して機動的に対応しつつ、技術開発を阻害しないバランスを模索しています。

既存法規の活用と分野別対応

AIに関連する課題、例えば個人情報保護や著作権侵害などについては、既存の個人情報保護法や著作権法といった法律の枠組みの中で対応することを基本としています。また、医療や金融といった特定の分野でAIを利用する際には、それぞれの分野の既存の業法やガイドラインの中でAIの利用に関するルールが検討・整備されています。

このように、新しい包括的な法律を作るのではなく、既存のリソースを最大限に活用し、必要に応じて分野ごとの個別対応を行うのが日本のAI規制の特徴です。

AI事業者ガイドラインの役割

経済産業省を中心に策定が進められている「AI事業者ガイドライン」は、日本におけるAIガバナンスの中核をなすものの一つです。これは、開発者や提供者、利用者がAIを倫理的かつ信頼できる形で事業に利用するための実践的な指針を示しています。

- 安全性

- 公平性

- 透明性

- カウンタビリティ(説明責任)

といった原則に基づき、事業者が自律的にリスクを管理し、適切なガバナンス体制を構築することを促す内容となっています。

EUのAI規制法が「遵守すべき義務」であるのに対し、日本のガイドラインは「推奨されるべき指針」という性格が強いと言えます。

EU法との比較における特徴

日本のアプローチは、法的拘束力のある「規則」としてリスク管理を義務付けるEUのAI規制法とは対照的です。日本は、事業者の自主性や柔軟性を重視し、ガイドラインや既存法の組み合わせで対応を図っています。

これは、イノベーションの推進をより強く意識したものであると言えますが、その一方で、EUのような明確な法的義務がないため、実効性をどう確保するかが課題とも考えられます。デジタル庁による政府機関でのAI利用ガイドライン策定など、特定の領域では具体的な指針作りも進んでいます。

日本は、EUとは異なる方法でAIのリスク管理と技術振興のバランスを取ろうとしています。ガイドラインを中心とした柔軟なアプローチは、急速な技術変化への適応性に優れる一方で、その実効性や国際的な整合性が今後の焦点となります。*5)

AI規制法の今後の見通し

AI規制法をめぐる世界の動きが加速する中、日本でも独自のアプローチによる法整備が進展しています。今後、AI技術の進化や国際的なルール形成にどう対応していくのかが、企業や社会の未来を大きく左右するでしょう。

日本版AI法の今後と法制度の柔軟性

日本では、2025年2月に人工知能関連技術の研究開発及び利用の促進に関する法案(いわゆるAI利用促進法案)が閣議決定され、その後同年5月に国会で可決・成立、6月4日に施行されました。

この法律は、日本初のAI単独法として、AIの研究開発・利用を推進するための基本方針や政府の責務を定める一方、EUのAI規制法のような罰則付きの義務規定ではなく、政府による調査・勧告や事業者の自主的な取組を重視する「ソフトロー型」の枠組みとなっている点が特徴です。

今後は、このAI利用促進法と「AI事業者ガイドライン(第1.1版)」などの指針を組み合わせながら、社会的状況や技術の進展に応じて必要な見直しや追加的なルール整備が行われていくことが想定されます。

国際調和とグローバル競争への対応

EUのAI規制法や米国・中国の動向を受け、日本も国際基準との調和を重視しています。日本版AI法でも「国外事業者についても、国内事業者と同じく制度の対象とすべき」という点が課題として指摘されています。

このことからも、グローバルなAI利用への対応が今後一層重要になることがわかります。今後は、国際的なルール形成への積極的な参画と、国内外の規制ギャップへの対応が重要な課題となります。

AI活用の社会的広がりと新たな課題

AIの社会実装が進む中、産業界・行政・医療・教育など幅広い分野で活用が拡大しています。一方で、知的財産や個人情報、倫理的課題への対応も求められており、今後はAIガバナンスの実効性や社会的受容性の向上が不可欠です。AI技術の進化とともに、新たな課題への柔軟な対応が今後のAI社会の安全と発展を左右します。

AI規制法は今後、世界的に技術革新と社会的信頼の両立、国際調和、そして新たな社会課題への対応力が問われる時代へと進化していくでしょう。*6)

AI規制法とSDGs

AI規制法とSDGs(持続可能な開発目標)は、「人間中心の社会」「倫理と技術の調和」という共通の理念を持ち、誰もが安心して技術の恩恵を受けられる社会を目指しています。AI規制法は、AIのリスク管理とイノベーション推進を両立させ、SDGsの目標達成を支える重要な役割を果たします。

AI規制法が特に貢献できるSDGs目標について見ていきましょう。

SDGs目標4:質の高い教育をみんなに

AI規制法により、教育分野でのAI活用における個人情報保護や公平性が担保され、すべての人が安心してAI教材や学習支援ツールを利用できる環境が整います。これにより、地域や経済格差を超えた質の高い教育機会の提供が現実のものとなります。

例えば、AIによる個別最適化学習が地方や開発途上地域の教育格差解消に役立っています。

SDGs目標8:働きがいも経済成長も

AI規制法は、労働現場でのAI活用における差別防止や安全性確保を義務づけることで、安心して働ける環境づくりと新たな雇用創出を促進します。産業のデジタル化とともに、すべての人が働きがいを感じられる持続可能な経済成長を後押しします。

実際に、AIによる自動採用システムの透明性向上や、障がい者雇用支援AIの普及が進んでいます。

SDGs目標10:人や国の不平等をなくそう

AIの判断に潜むバイアスや差別を規制法で抑制することで、社会的・経済的な不平等の是正に寄与します。特に、AIによる公共サービスや金融サービスの公正な提供が、弱者やマイノリティの包摂に直結します。

例えば、AIによる融資審査での差別排除や、行政手続きの自動化によるマイノリティ支援が進んでいます。

SDGs目標16:平和と公正をすべての人に

AI規制法は、民主主義・法の支配・人権尊重を基盤とし、監視社会化やプライバシー侵害を防ぐ仕組みを強化します。これにより、誰もが安心して暮らせる公正な社会の実現に貢献します。

顔認証AIの公共利用制限や、AIによる虚偽情報拡散の抑制策がこの具体例です。

このように、AI規制法は、SDGsの多くの目標に横断的に貢献し、AIの恩恵を公平かつ持続的に社会全体へ広げるための重要な基盤となります。*7)

>>SDGsに関する詳しい記事はこちらから

まとめ

EUのAI規制法は、技術革新と社会的安全のバランスを模索する世界的に影響の大きい取り組みです。一方で、現状日本の「ソフトロー」アプローチは、強制力を持つ欧州のAI Actと異なり、柔軟性を重視しています。

2025年には、日本と海外でAIをめぐる動きが一段と加速しました。

日本では、経済産業省とNEDOが懸賞金総額最大約8億円のコンテスト「GENIAC-PRIZE」を開始し、生成AIを活用した業務効率化や安全性向上など4つのテーマで革新的なAIソリューションを募集しました。

また、同年2月に閣議決定され5月に成立したAI利用促進法により、不正目的のAI利用に対する国の調査権が認められる一方で、罰則規定は設けず、事業者の自主的な取組とガイドラインに基づく「日本型モデル」が選択されたことが明確になりました。

世界的には規制アプローチに大きな差異が生じています。

EUではAI規制法の本格適用に向けて、禁止AIや高リスクAIに対する巨額の制裁金(禁止AIについては最大3,500万ユーロまたは世界売上高の7%、その他の違反については最大1,500万ユーロまたは3%)が規定されており、AppleやMetaに対するデジタル市場法(DMA)違反をめぐる制裁金などとも相まって、巨大テック企業への厳格な姿勢が鮮明になっています。

一方、米国では連邦レベルの包括的AI規制はなお模索段階で、州ごとの個別規制や、州のAI規制を制限しようとする税制関連法案などをめぐる議論が続いており、産業競争力とリスク管理のバランスをどのように取るかが課題となっています。

こうした規制の違いは、テクノロジー後進国にとっては「規制裁定」の機会を生み出す一方、国際的な規制調和の欠如がもたらす混乱も懸念されます。

AI規制に関する知識を深めることは、単なる法律情報の把握ではなく、私たちの社会がどのような未来を選択するかという根本的な問いへの参加です。個人レベルでは、AI製品・サービスの選択において倫理的側面に注目し、消費者として声を上げることが重要です。

あなた自身のAI利用に関して、どのような価値観を優先していますか?

急速に発展するAI技術と社会制度の共進化の過程に、私たち一人ひとりが意識的に関わることで、人間中心の持続可能なAI社会を実現できるでしょう。私たちの小さな選択の積み重ねが、より良いAIの未来を形作るのです。*8)

<参考・引用文献>

*1)AI規制法とは

総務省『EUのAI規制法案の概要』(2022年)

総務省『特集② 進化するデジタルテクノロジーとの共生 第2節 AIに関する各国の対応(1) 欧州連合(EU)』(2024年)

European Parliament『EU AI Act: first regulation on artificial intelligence』(2025年2月)

European Commission『Commission publishes the Guidelines on prohibited artificial intelligence (AI) practices, as defined by the AI Act.』(2025年2月)

Wikipedia『AI法』

内閣府『「AI制度に関する考え方」について(概要)』(2024年5月)

総務省『AI 原則の事業者による実施とコーポレートガバナンス』

総務省『令和6年版 情報通信白書 第Ⅰ部 第2 節 AIに関する各国の対応』(2024年3月)

JETRO『EU、AIを包括的に規制する法案で政治合意、生成型AIも規制対象に』(2023年12月)

JETRO『EU理事会、AI法案を採択、2026年中に全面適用開始へ』(2024年5月)

JETRO『EUのAI規則、禁止されるAI利用のルールが適用開始に』(2025年2月)

国際貿易投資研究所『EU、世界初の人工知能(AI)包括規制法成立-世界標準を目指して、2026年に全面施行―』(2024年6月)

日経XRECH『EUで厳罰付きのAI規制法が成立、心もとない日本企業の備え』(2024年5月)

欧州連合日本政府代表部『EU AI規則の概要』(2024年9月)

*2)AI規制法が発効した背景

経済産業省『AI事業者ガイドライン(第1.1版)概要』(2025年3月)

経済産業省『我が国の AI ガバナンスの在り方 ver. 1.0』(2021年1月)

経済産業省『欧州AI政策について』(2021年3月)

経済産業省『AI関連政策の海外動向』(2023年3月)

経済産業省『AI 事業者ガイドライン(第 1.0 版)』(2024年4月)

METI Journal『AIが主戦場!日本発「標準」を世界に広める経産省の戦略とは』(2024年2月)

JETRO『フランスを中心とする欧州におけるAI規制法の概要とコンテンツ産業等における影響調査』(2025年3月)

NTT東日本『なぜEUは、生成AIを規制しようとしているのか』(2024年7月)

AI研究所『【2025】日本のAI法規制とは?生成AIがもたらすリスクや信頼できる生成AIの特徴』

日経XTECH『AIで差別や偏見、経産省のガバナンス指針で回避となるか』(2021年8月)

外務省『軍縮・不拡散・原子力の平和的利用 AIと自律性の責任ある軍事利用に関する政治宣言』(2024年6月)

*3)AI規制法のメリット

欧州連合日本政府代表部『EUのデジタル政策の概要』(2024年9月)

デジタル庁『行政における生成AIの適切な利活用に向けた技術検証の環境整備』(2024年5月)

デジタル庁『行政におけるAIの活用に向けた取組、デジタル・新技術を活用した地方創生』(2025年3月)

経済産業省『AI 事業者ガイドライン案』(2024年1月)

SoftBank『AIの法規制をめぐる各国の動向と日本企業への影響』(2025年3月)

総務省『AI 規正論』

日本総研『生成AIの台頭で大きく注目されるAIガバナンス~欧米のAI・デジタル動向の考察と示唆~』(2024年9月)

情報処理推進機構『テキスト生成AIの導入・運用ガイドライン』(2024年7月)

黒川 哲志『「法律による行政の原理」から見た行政過程でのAI活用』(2023年1月)

*4)AI規制法のデメリット・課題

総務省『令和6年版 情報通信白書 第Ⅰ部 第1 節 AIの進化に伴う課題と現状の取組』(2024年)

経済産業省『「AI事業者ガイドライン案」に対するご意見及びその考え方』(2024年3月)

内閣府『AI に関する暫定的な論点整理』(2023年5月)

東京大学『AI 規制に対する⽇本の事業者と市⺠の考え⽅に関する調査から考える今後の展望』(2024年11月)

BBC『AI規制で「圧倒的な意見の一致」とマスク氏 IT大手と米議員らが会議』(2023年9月)

情報処理推進機構『AIの社会実装課題と対策』(2019年)

AI総合研究所『AI規制法とは?日本・海外の事例を踏まえ、その内容と影響を徹底解説』(2024年6月)

東洋経済ONLINE『生成AIの「無断学習」を規制するうえでの論点 強く規制することにはデメリットも』(2024年1月)

*5)日本におけるAI規制法の現状

内閣府『AI政策の現状と制度課題』(2024年8月)

内閣府『中間とりまとめ(案)』(2025年2月)

経済産業省『AI事業者ガイドライン(第1.1版)概要』(2025年3月)

経済産業研究所『中国生成AI規制における「規制と技術革新」の均衡点―中国AI戦略の把握に向けた一考察―』(2024年)

経済産業省『知的財産推進計画2025に向けた取組等について』(2024年12月)

SoftBank『AIの法規制をめぐる各国の動向と日本企業への影響』(2025年3月)

GoogleCloud『EU の AI 規制法への対応: Google Cloud のプロアクティブなアプローチ』(2024年7月)

日本銀行『生成AI導入に向けた課題とリスク』(2025年1月)

個人情報保護委員会『生成 AI サービスの利用に関する注意喚起等について』(2023年6月)

Japan Business Press『AI規制法、先陣を切った欧州は何を禁じた?中国は政府批判の封じ込め狙い、日本はガイドラインで法的拘束力なし』(2024年4月)

日本経済新聞『デジタル庁が生成AIガイドライン、機密情報も学習可能に』(2025年5月)

日経XTECH『デジタル庁が政府向け生成AIガイドライン案を公表、各府省にAIの最高責任者』(2025年3月)

日経XTREND『日本版「AI法」登場 AIビジネスへの影響とは?』(2025年4月)

*6)AI規制法の今後の見通し

経済産業省『AI 事業者ガイドライン(第 1.01 版)』(2024年11月)

経済産業省『経済安全保障に関する産業・技術基盤強化 アクションプラン再改訂にむけて』(2025年4月)

NRI『日本型AI規制の可能性』(2024年9月)

Reuters『アングル:欧州のAI規制法、具体的な実施規則が焦点 企業は骨抜き狙う』(2024年9月)

JETRO『AIの発展に伴い拡大する事業・サービスの展望(欧州)』(2025年3月)

大和総研『AI倫理とは?-生成AIを開発・活用するために企業が考えなければいけないこと-』

東京大学『AI 規制に対する⽇本の事業者と市⺠の考え⽅に関する調査から考える今後の展望』(2024年11月)

MUFG『経済情報:AIの経済・金融への影響と各国の規制や支援の枠組み』(2024年9月)

NTT西日本『国内初の「AI法案」が閣議決定~罰則はなく自主性重視、イノベーション促進の方向』(2025年4月)

NRI『生成AIの展望〜生成AIの可能性と変わる未来〜』(2024年2月)

Spaceship Earth『第四次産業革命とは?いつ起こった?きっかけと日本への影響・メリット・デメリットをわかりやすく解説!』(2025年3月)

日本総研『生成AIの台頭で大きく注目されるAIガバナンス ~欧米のAI・デジタル動向の考察と示唆~ 【後編】』(2025年4月)

研究開発戦略センター『人工知能研究の新潮流2025 ~基盤モデル・生成AIのインパクトと課題~』(2025年3月)

*7)AI規制法とSDGs

国際連合広報センター『国連総会、人工知能(AI)に関する画期的な決議を採択』(2024年4月)

内閣府『人間中心の AI 社会原則』(2019年3月)

文部科学省『UNESCOのAI倫理勧告』(2022年3月)

外務省『第78回国連総会サイドイベント「SDGs推進のためのAI」における赤堀毅地球規模課題審議官によるステートメント』(2023年9月)

Journal of Ethics and Legal Technologies『The Compatibility Between SDGs and the EU

Regulatory Framework of AI』(2024年6月)

*8)まとめ

経済産業省『生成AIの社会実装に向けたプロジェクト「GENIAC-PRIZE」を開始します』(2025年5月)

NEDO『本公募「NEDO懸賞金活用型プログラム/GENIAC-PRIZE」に係る公募について(懸賞広告)』(2025年5月)

日本経済新聞『AI規制「日本流」探る 国に調査権、新法案を閣議決定』(2025年2月)

日本経済新聞『最大1億円の懸賞金、業務効率化のAI開発に 経産省』(2025年5月)

日本経済新聞『不正目的のAIを国が調査 法案の全容判明、罰則は盛らず』(2025年1月)

日経XTECH『罰則規定ないAI法案が閣議決定、開発促進と最少のリスク対策で「日本型モデル」探る』(2025年3月)

NIKKEI Digital Governance『Apple制裁、調査着手から1年で 欧州DMAの威力とは』(2025年5月)

Yahoo!ニュース『国内初「AI新法」が閣議決定 日本のAI産業発展には「規制の実効性をどのように確保するのか」が重要【弁護士解説】』(2025年5月)

東洋経済ONLINE『対話型からエージェントへ 「生成AI」群雄割拠の最前線。オープンAI、GAFAM、中国勢……』(2025年5月)

Reuters『EU、アップルとメタに総額7億ユーロ制裁金 巨大テック規制違反で初』(2025年4月)

Bloomberg『米税制法案、州のAI規制封じる条項盛り込む-ハイテク大手に恩恵も』(2025年5月)

この記事を書いた人

松本 淳和 ライター

生物多様性、生物の循環、人々の暮らしを守りたい生物学研究室所属の博物館職員。正しい選択のための確実な情報を提供します。趣味は植物の栽培と生き物の飼育。無駄のない快適な生活を追求。

生物多様性、生物の循環、人々の暮らしを守りたい生物学研究室所属の博物館職員。正しい選択のための確実な情報を提供します。趣味は植物の栽培と生き物の飼育。無駄のない快適な生活を追求。